Décider est donc une fonction intrinsèque à l’administration, mais décider n’est pas toujours le fruit d’un processus entièrement humain. L’administration s’est toujours dotée de règles, de documents, de cadres, pour décider, quand bien même aucune obligation ne le lui imposerait : le pouvoir discrétionnaire dont jouit très souvent l’administration est limité par elle-même.

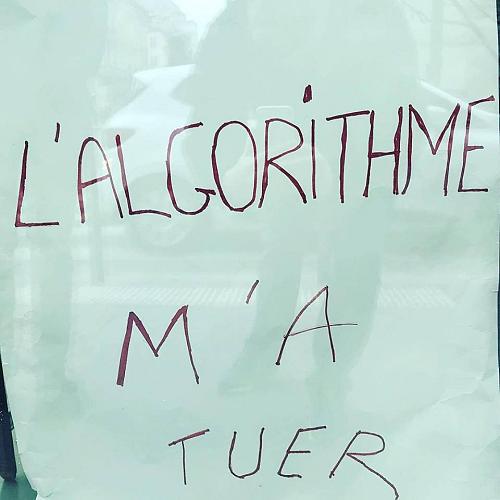

De plus, l’arrivée ces derniers temps d’un nouvel outil pour l’administration, l’algorithme, change radicalement la manière dont on peut concevoir la décision administrative. Skip Machine lave plus blanc que blanc ; l’algorithme décide plus efficacement que l’humain. Il en résulte un miracle : la décision administrative algorithmique. Le législateur est intervenu, pour répondre à un certain nombre de craintes. Mais la pratique administrative tend à contourner ces protections grâce à un nouvel outil, l’algorithme d’aide à la prise de décision.

Avant toute chose, il est nécessaire de s’entendre sur la notion de décision et celle d’algorithme. Nous entendons ici un algorithme (ou son équivalent juridique de « traitement algorithmique ») comme une suite d’opérations mathématiques avec en entrée plusieurs paramètres et en sortie un résultat unique (mais pas forcément reproductible, comme nous le verrons plus tard). Un algorithme n’a donc pas à être compliqué : un rapport sénatorial a ainsi pu comparer une recette de cuisine à un algorithme. [1] Il ne s’agit pas forcément non plus d’un programme informatique ou de lignes de codes exécutables : un algorithme peut également être une série de formules dans une feuille de calcul. [2] On classera toutefois les algorithmes en deux catégories : les algorithmes auto-apprenants et les autres. Les premiers (on parlera également d’« intelligence artificielle », de « machine learning » ou de « deep learning ») fonctionnent avec une phase d’apprentissage préalable. Dans un premier temps, l’algorithme auto-apprenant s’entraîne sur un jeu de données dont le résultat attendu est connu (par exemple : « cette image est un chaton » ou « cette image n’est pas un chaton ») et s’adapte en comparant ses résultats à ceux attendus. Une fois cette phase terminée, il est utilisé alors que le résultat attendu n’est pas connu (dans notre exemple, il sera censé distinguer les images de chatons des autres). Le résultat d’un algorithme auto-apprenant n’est pas reproductible puisqu’il dépendra de la phase d’apprentissage et de la qualité du jeu de données initial. Les autres algorithmes, ceux qui ne sont pas auto-apprenants, ont un résultat reproductible puisqu’il ne repose pas sur une phase préalable d’apprentissage.

Une décision administrative, quant à elle, est un acte administratif (au sens de document émanant d’une administration [3]) décisoire. Lorsque l’administration constate quelque chose (ce que font beaucoup d’autorités de régulation, par exemple), elle ne fait pas de choix et son acte n’est donc pas une décision.

Enfin, nous entendrons une décision administrative algorithmique comme un type de décision administrative dans laquelle un algorithme a été utilisé durant le processus de prise de décision. L’algorithme n’a pas à être le seul fondement à la décision pour que celle-ci soit qualifiable de décision administrative algorithmique. Il faut distinguer la décision algorithmique de l’algorithme d’aide à la prise de décision : le premier fonde la décision, le deuxième est utilisé en amont de la décision et ne la fonde alors pas.

Arrêtons-nous tout d’abord sur ce qui motive l’administration à utiliser des algorithmes (I). Voyons ensuite les barrières prévues par le droit pour les décisions algorithmiques (II) et comment l’administration les contourne grâce aux algorithmes d’aide à la prise de décision (III). Enfin, étudions les conséquences de ces algorithmes d’aide à la prise de décision sur nos droits fondamentaux (IV).

I. Un recours aux décisions algorithmiques de plus en plus important

Il est difficile – pour ne pas dire impossible – de systématiser l’utilisation d’un algorithme. L’administration n’est jamais tenue d’y avoir recours, ce n’est qu’une faculté (explicitement admise par la loi depuis 2016 [4]).

En tout état de cause, lorsqu’elle y a recours, cela peut être pour atteindre deux objectifs. Premièrement, il peut s’agir d’une situation dans laquelle l’administration doit prendre beaucoup de décisions dans un laps de temps restreint. Elle veut alors accélérer la prise de décision. Dans ce cas, l’algorithme est souvent très simple et il s’agit principalement de décisions administratives individuelles (c’est-à-dire dont le destinataire est une personne nommée ou un groupe de personnes individualisées). Le cas des algorithmes locaux de Parcoursup illustre parfaitement cette situation : les universités doivent, en quelques semaines, classer des milliers de candidatures en attribuant à chaque candidat·e un rang précis ; les algorithmes locaux de Parcoursup appliquent à l’ensemble des candidat·es une même règle pour donner in fine un rang à chaque candidature. Les algorithmes locaux de Parcoursup sont une simple feuille de calcul sur laquelle les commissions de classement ont donné une importance plus ou moins grande à certains critères académiques parmi ceux transmis par la plateforme aux universités (notes, appréciations, lycée d’origine, etc. [5]).

Deuxièmement, il peut s’agir de détecter ce que l’on estime impossible à trouver par une analyse humaine : il s’agit de la recherche de signaux faibles. Dans cette situation, le recours aux algorithmes auto-apprenants est le plus souvent nécessaire. Par exemple, la surveillance algorithmique des réseaux de communication (parfois appelée « boîtes noires ») permises depuis la loi renseignement de 2015 [6] repose sur des algorithmes auto-pprenants dont le but est de détecter des risques à caractère terroriste qu’on estime indétectable par un analyste du renseignement.

II. L’algorithme comme fondement de la décision administrative : une protection théorique contre les abus de la décision administrative algorithmique

Ce panorama étant posé, une peur peut légitimement naître : comment être certain·e qu’un algorithme a pris la bonne décision ? Il est intellectuellement plus facile de contester une décision prise par un·e humain·e que de contester une décision prise par une machine dont l’aléatoire est réputé neutralisé.

Le droit offre un certain nombre de mesures protectrices – bien qu’insuffisantes en pratique – lorsqu’un traitement algorithmique a été le fondement d’une décision. Autrement dit, lorsque l’administration, pour prendre sa décision, se base sur les résultats d’un algorithme, le droit pose des limites. L’article L. 311-3-1 du code des relations entre le public et l’administration énonce ainsi le droit de se faire communiquer les « règles définissant ce traitement ainsi que les principales caractéristiques de sa mise en œuvre » [7] dans le cas d’une décision administrative individuelle prise sur le fondement d’un traitement algorithmique. Ainsi, lorsque l’administration prend une décision individuelle à l’aide d’un algorithme, un droit à se faire communiquer certaines informations sur l’algorithme naît au bénéfice du destinataire de la décision. Une forme de transparence est ainsi posée et d’elle découle une forme de contrôle sur la qualité de l’algorithme, donc de la décision qui en découle.

Le Conseil constitutionnel est également venu poser un garde-fou important à l’usage d’algorithmes dans les décisions administratives. Il a ainsi précisé que l’administration doit pouvoir expliquer et reproduire ses résultats : les algorithmes auto-apprenants sont donc théoriquement exclus de la prise de décision. [8]

Enfin, précisons également que le code source des algorithmes sont des documents administratifs au sens de la loi. [9] À ce titre, il est possible, en dehors des cas de décisions administratives individuelles, de se faire communiquer de tels documents. [10]

III. L’algorithme comme simple aide : l’absence de toute garantie contre les algorithmes d’aide à la prise de décision

La pratique administrative tend à exclure de plus en plus les algorithmes de la prise de décision. Si l’algorithme n’est plus considéré comme ayant fondé une décision, alors les limites posées (notamment l’interdiction de recourir à des algorithmes auto-apprenants donc aux résultats non reproductibles) n’existent plus du tout.

C’est ce qu’il se passe avec le recours des algorithmes dits « d’aide à la prise de décision ». Ces algorithmes sont utilisés bien en amont de la prise de décision : il s’agit de guider l’administration dans son action au quotidien, avant qu’une décision ne soit prise. On retrouve de tels algorithmes par exemple dans la lutte contre la fraude fiscale et douanière, dans la lutte contre le terrorisme, la police prédictive, etc.

Ces algorithmes d’aide à la prise de décision fonctionnent selon une même logique : une alerte ou une recommandation est levée par l’algorithme. Un·e agent de l’administration reçoit cette alerte ou cette recommandation, puis décide de prendre ou non une décision. Le fondement de la décision n’est donc plus l’algorithme, qui a seulement invité l’agent à s’intéresser à une situation particulière. L’algorithme d’aide à la prise de décision n’est plus au fondement de la décision, il est détaché.

Ainsi, l’algorithme Paved (« plateforme d’analyse et de visualisation évolutive de la délinquance ») de la gendarmerie ne fait qu’afficher les zones à risques : il ne détermine pas les zones dans lesquelles les patrouilles seront positionnées. L’agent choisira seul·e de placer ses patrouilles dans les zones à risque ou non. Il en va de même pour les boites noires utilisées par les services de renseignement (cf. supra pour leur présentation) : elles ne lèvent qu’une alerte sur une potentielle menace, libre ensuite à l’analyste du renseignement de procéder ou non à une surveillance plus ciblée.

Ce même fonctionnement vaut également pour les algorithmes de Bercy chargés de détecter les potentielles fraudes fiscales : les agents du fisc sont toujours libres de procéder ou non au contrôle fiscal.

Ces exemples sont réels et l’hypocrisie est flagrante. Si l’administration demande à

un algorithme de l’aider, soit en augmentant le nombre de situations traitées, soit en détectant ce qu’un·e humain·e ne pourrait pas voir, pourquoi ne pas suivre ses recommandations ? On pourrait répondre que lorsqu’une alerte ou une recommandation est émise, l’agent pourrait refaire le traitement sur la situation spécifique afin de vérifier la qualité du résultat de l’algorithme. Cependant, premièrement, aucune obligation n’impose à l’administration une telle vérification. Deuxièmement, ce serait omettre les résultats négatifs qui impliquent une forme de validation de la situation par l’algorithme. Troisièmement, ce serait réduire drastiquement les gains de productivité demandés à ces algorithmes dans certaines situations. Quatrièmement, enfin, certains cas ne se prêtent tout simplement pas à une telle vérification, notamment lorsqu’il est demandé à l’algorithme de repérer les signaux faibles.

En réalité, lorsqu’une alerte ou une recommandation est levée par un algorithme d’aide à la prise de décision, l’administration se bornera à vérifier les erreurs grossières pour les cas positifs. Elle ne vérifiera jamais les résultats négatifs. L’humain·e chargé·e de réceptionner les alertes ou recommandations n’aura qu’un rôle de vérification a minima, au risque, autrement, d’aller à l’encontre des gains de production demandés. Le doute sera donc nécessairement au détriment de l’administré·e. Éventuellement, il peut être demandé à l’agent d’opérer un classement pour ne prendre en considération qu’un nombre limité de cas. On peut penser qu’un tel choix est fait dans les domaines où un contingentement existe en fait ou en droit (nombre limité de gendarmes mobilisables sur le terrain, quota de mises sous surveillance, etc.). Mais rien n’indique que ce choix ne soit pas dû au hasard (notamment lorsque l’humain·e n’est pas censé·e pouvoir apprécier la situation).

IV. Des conséquences négatives concrètes sur les droits fondamentaux

Le résultat de tout cela est assez décevant. D’une part, l’usage même de ces algorithmes d’aide à la prise de décision implique un droit à un recours effectif limité. Dès 2016 [11], la Cour suprême du Wisconsin affirmait qu’il n’est pas possible de contester le résultat d’un algorithme d’aide à la prise de décision puisque seul l’humain·e a pris la décision : la seule décision attaquable devant un juge est celle prise par un·e humain·e, et elle seule, même si un algorithme a aidé à cette prise de décision. Il n’existe donc pas de recours direct contre ces algorithmes puisqu’ils sont passés par le truchement d’un·e humain·e avant la prise de décision en tant que telle.

Mais, même dans le cas des décisions administratives algorithmiques – c’est-à-dire celles dont le fondement est un algorithme, contrairement au cas des algorithmes d’aide à la prise de décision –, les droits fondamentaux sont limités. Dans ces situations, on se heurtera au pouvoir discrétionnaire de l’administration : l’administration, très souvent, a une large possibilité d’action et le rôle du juge se limite à vérifier l’absence d’« erreur manifeste d’appréciation », c’est-à-dire l’absence d’erreur grossière. Une décision administrative algorithmique ne sera qu’une décision dans laquelle l’administration a voulu, de son chef, limiter son aléa. Mais la manière de le limiter, les paramétrages de l’algorithme, restent un choix qui n’est pas vraiment contestable. La transparence (lorsqu’elle est applicable) permettra à l’administré·e de vérifier ces erreurs grossières (on peut par exemple penser aux cas de discriminations), mais le doute se fera toujours au bénéfice de l’administration.

D’autre part, l’usage de tels algorithmes va de pair avec une augmentation du nombre de données traitées. Pour utiliser des algorithmes, encore faut-il avoir des informations pour les nourrir. L’administration est donc incitée à collecter et traiter de plus en plus de données. La récente volonté de Bercy de récolter les données publiques des réseaux sociaux n’est que le dernier exemple d’une liste très longue. Avec cette collecte, ce sont le droit à la vie privée et familiale ou encore le droit à la liberté d’expression et d’information qui se retrouvent limités.

Le résultat n’est pas réjouissant. L’administration se sert d’algorithmes, mais parfois tellement en amont dans son travail qu’ils ne sont pas considérés comme ayant fondé la décision administrative, sapant au passage les garanties posées par le droit. Un problème de taille se pose : la notion de décision administrative, telle qu’elle est conçue aujourd’hui, a-t-elle encore une légitimité à l’heure des lgorithmes ? Doit-elle évoluer pour réintégrer dans son champ les algorithmes d’aide à la prise de décision ?